引入参数概率估计

MartinLiebig

管理员,版主,员工,RapidMiner认证分析师,RapidMiner认证专家,大学教授职位:3362年

MartinLiebig

管理员,版主,员工,RapidMiner认证分析师,RapidMiner认证专家,大学教授职位:3362年特征准备是数据科学中最具挑战性和最重要的任务之一。乐鱼平台进入这项任务有三个方面

- 保存最多的信息以获得最佳结果

- 将属性的数量减少到最小以获得最佳运行时

- 使数据易于理解的算法

通过使数据易于理解,您可以获得最佳性能。一个给定的学习者可能善于发现某些模式,但对其他模式可能是盲目的。广义线性模型(GLM)就是一个很好的例子,它在检测线性模式方面表现良好,但在检测非线性模式方面表现不佳。新的算子单变量概率估计器是对特征准备工具包的一个有用的补充。

了解您的数据

经典CRISP-DM周期中的前两个任务是业务理解和数据理解。在这些阶段中,分析人员对给定的任务了解了很多。有了这些信息,他通常可以对属性分布推断出合理的假设。为了说明这一点,让我们来看两个例子。

在客户分析场景中,您可能有一个属性NumberOfCalls。这包括你给客户打电话的次数。根据统计知识,我们可以合理地假设这个属性是泊松分布的。

在诸如预测性维护之类的传感器分析中,您经常需要处理大量测量数据。由于中心极限定理,传感器的响应通常是正态分布的。

使用此信息

在分类任务中,我们假设属性有能力区分我们的类。我们可以假设这两个类各有一个底层分布。这种分布遵循相同的模式(例如正态分布),但参数不同。现在我们可以估计每个类的参数。在二项情况下,我们得到两个分布。

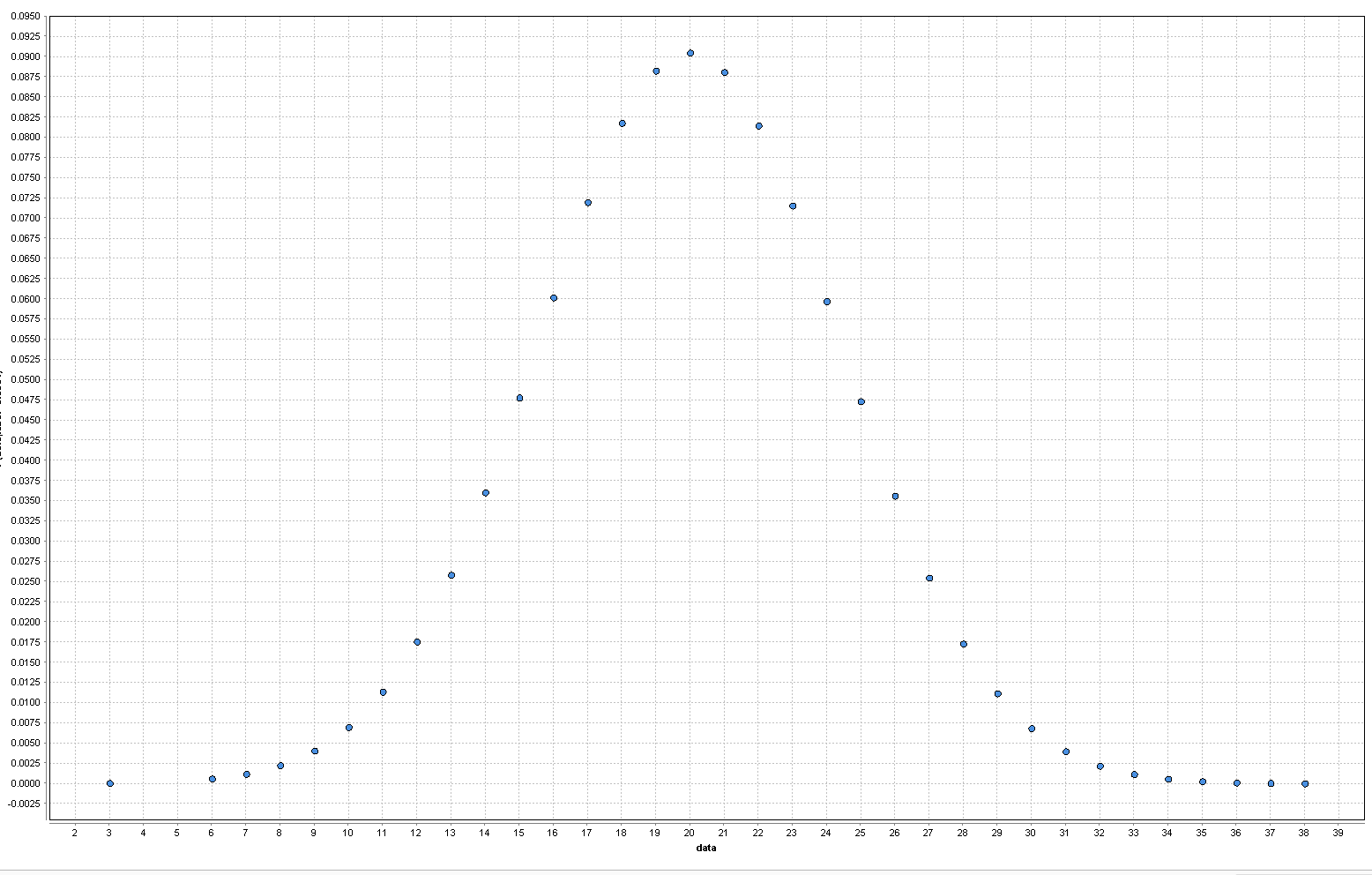

泊松分布的PDF格式。Low和High值被映射为低概率,而20左右的值具有高概率。如果我们为给定示例取一个值,我们可以计算该值适合这些分布之一的概率。这为我们的分类带来了两个新属性:1)X属于FirstClassDistribution的概率和2)X属于SecondClassDistribution的概率。

泊松分布的PDF格式。Low和High值被映射为低概率,而20左右的值具有高概率。如果我们为给定示例取一个值,我们可以计算该值适合这些分布之一的概率。这为我们的分类带来了两个新属性:1)X属于FirstClassDistribution的概率和2)X属于SecondClassDistribution的概率。

这是一个非线性特征变换。对于所有发行版,请考虑两种情况。一方面,与平均值相比较小或较大的属性值被映射到较低的概率。另一方面,接近平均值的值被映射为更高的概率。这导致了问题的线性化。像GLM或线性支持向量机这样的线性模型可以比原始形式更容易地处理这些值。另一种效果出现在随机森林或gbt等基于树的模型中,它们也可以更好地处理这些数据,因为它们需要更少的切割来实现相同的分离。

在RapidMiner中使用它可以直接使用称为单变量概率估计器的新算子。设置主要是分布假设和使用分布假设的属性。截至2017年12月,我们支持以下发行版:

- 正态分布(即高斯分布)

- 泊松

- 对数正态

- 指数

- 伯努利

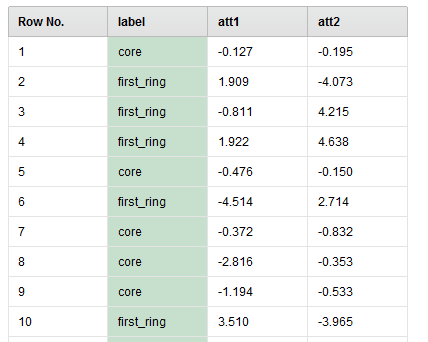

考虑这个数据集:

对上述数据集应用单变量概率估计算子会产生如下输出:

可以看到,每个先前存在的属性都添加了2个新属性。这些是att1或att2中的值属于特定类的概率。

该算子还提供了一个预处理模型。该模型可用于在不同的数据集上应用相同的转换。这通常是必要的,如果你想预处理未知数据,即数据类似于原来的结构,但由新的例子组成的模型看不见。

上面显示的数据是一个“环形数据集”。将att1与att2对比,结果如下图所示:

我们看到,在正态分布的类周围有一个外圈。该数据集不可用线性模型分离。

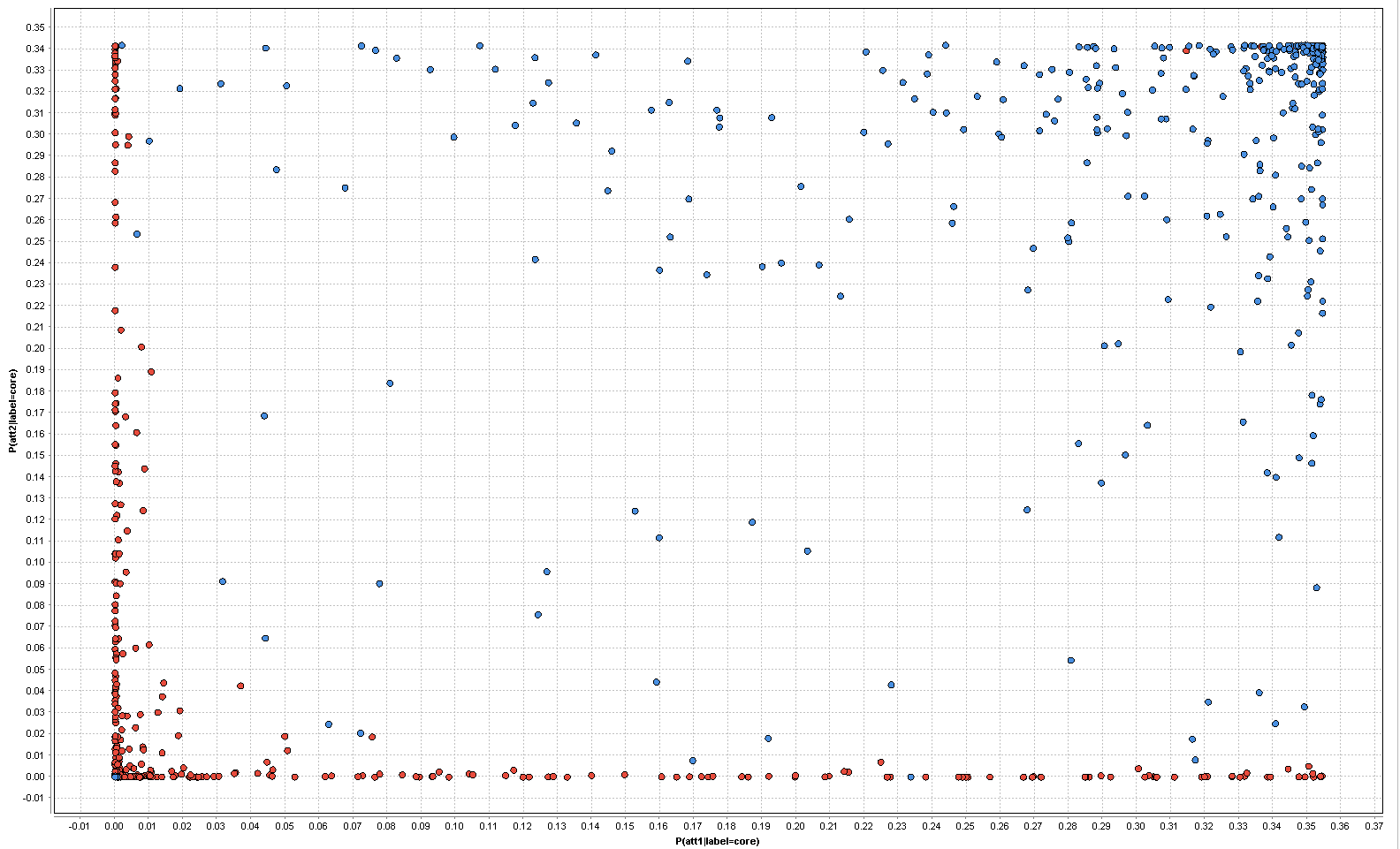

转换之后,我们得到了四个新属性。如果我们只是在平面上绘制P(att1|标签=核心)vs P(att2|标签=核心),我们得到以下结果:

在这个平面上,你已经可以看到线性模型可以取得很好的成功。因此,采用这种变换的线性支持向量机的AUC为0.97,而不采用这种变换的线性支持向量机的AUC仅为0.43。

所描述的过程可以作为单变量概率估计算子的教程过程。

德国多特蒙德